NVIDIA A100-PCIE:定义AI计算新标准

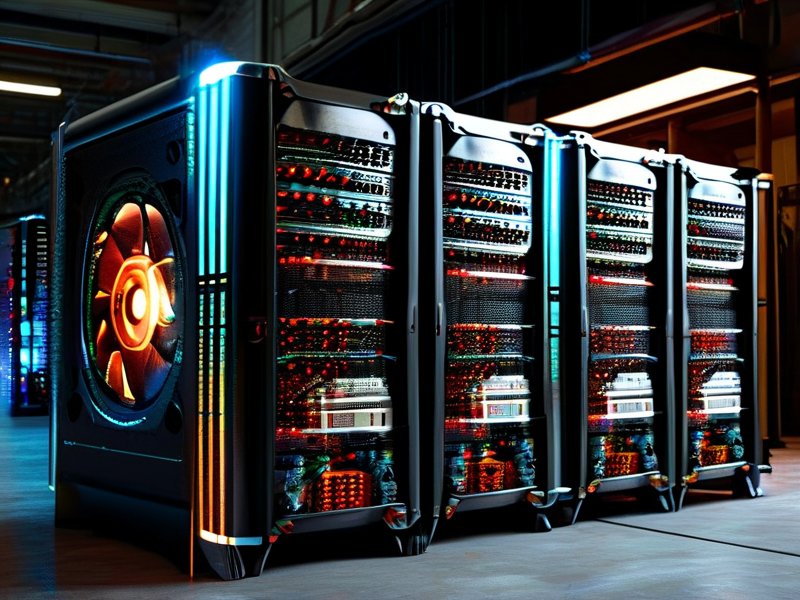

在人工智能技术爆发式增长的今天,数据中心的算力需求正以指数级速度攀升。作为这一领域的革命性产品,NVIDIA A100-PCIE凭借其突破性的架构设计,重新定义了AI计算的边界。这款基于NVIDIA Ampere架构的GPU,通过第三代Tensor Core和全新稀疏计算技术,将AI训练与推理性能提升至前所未有的水平。

其核心技术创新包括:

- 40GB HBM2e显存与1.6TB/s带宽的组合,解决了大规模模型训练中的内存瓶颈问题;

- 多实例GPU(MIG)技术可将单个A100分割为7个独立实例,实现资源的灵活分配;

- 支持FP8混合精度计算,使AI模型训练效率提升至前代产品的20倍。

极速引擎重塑数据中心未来

随着企业数字化转型进入深水区,数据中心正面临三大核心挑战:算力密度不足、能耗成本过高、异构计算兼容性差。而A100-PCIE的出现,为这些问题提供了系统性解决方案。通过PCIe 4.0接口与标准服务器架构的兼容设计,企业无需重构现有数据中心基础设施,即可实现算力的平滑升级。这种“即插即用”的部署模式,极大降低了AI算力普及的技术门槛。

在实际应用场景中,A100-PCIE的影响力已显现:

- 在超大规模自然语言处理领域,其支持的BERT-945B模型训练时间缩短至4.6小时;

- 医疗影像分析中,将肺部CT扫描的AI诊断速度提升至每秒240帧;

- 通过NVLink技术构建的DGX SuperPOD集群,可实现EB级数据的实时分析处理。

正如NVIDIA创始人黄仁勋所言:“A100不仅是芯片,更是未来数据中心的神经中枢。”随着5G、物联网和元宇宙概念的推进,这种兼具极致性能与部署弹性的计算架构,正在成为企业构建智能基础设施的核心选择。欲了解更多技术细节与行业应用案例,点击访问NVIDIA A100-PCIE产品页面,开启您的AI算力革命。